Fcebook ha aggiunto nuovi strumenti di intelligenza artificiale per la ricerca dei contenuti falsi, le fake news, e li ha messi a disposizione dei partner che si occupano di controllare manualmente l’autenticità dei contenuti pubblicati sul social network.

In particolare, di recente è stato pubblicato Rosetta, un sistema di AI (Artificial Intelligence) che può vedere le immagini e leggere il testo abbinato. In altre parole, il computer è in grado di comprendere i famosi e onnipresenti meme, e cerca di comprendere se dietro a ognuno di questi si nascondano informazioni false o comunque contrarie alle linee guida.

Si dà la caccia alla falsa informazione, al razzismo, ai fondamentalismi, all’incitazione all’odio e a molti altri comportamenti che finiscono per rendere tossico il dibattito tra le persone – e in ultima analisi rischiano di mettere lo stesso Zuckerberg su una scomoda graticola pubblica, com’è accaduto con la vicenda di Cambridge Analytica. Da un punto di vista tecnologico, rendere un computer capace di capire un’immagine è però una sfida molto complessa; Facebook si spinge oltre con strumenti in grado di analizzare anche i video.

L’approccio è lo stesso già messo in pratica con gli articoli e post, nel corso degli ultimi mesi. I sistemi automatici analizzano una serie di fattori per capire se un contenuto (articolo, foto o video) può essere falso o pericoloso. Quelli presi in considerazione sono il testo, i commenti, il numero di condivisioni, un’eventuale promozione pubblicitaria e altro ancora.

Se i sistemi AI di Facebook rilevano un contenuto sospetto, lo stesso viene segnalato a uno o più dei 27 partner selezionati di Facebook. A questo punto un team di persone in carne e ossa fa le opportune verifiche per capire se ci si trova davvero davanti a una fake news o un errore del sistema digitale. Questo meccanismo esiste anche in Italia, dove il partner di Facebook è Pagella Politica.

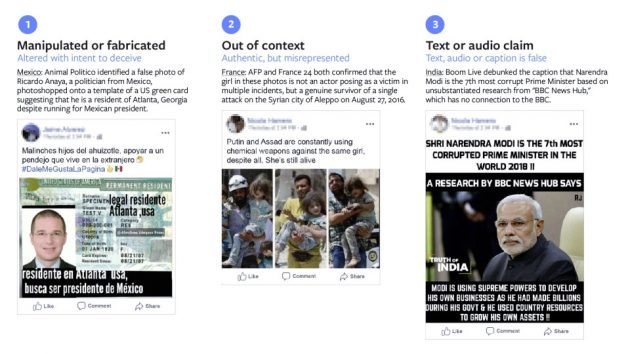

Facebook si è concentrata su tre grandi categorie di falso: la manipolazione vera e propria, la decontestualizzazione e le false affermazioni. Non sempre però una foto manipolata equivale a disinformazione: a volte può essere un semplice scherzo, a volte satira. E dopotutto rientra nella definizione di manipolazione anche la semplice aggiunta di un adesivo digitale – opzione che offre la stessa Facebook. E lo stesso vale per i video.

Non si può bloccare tutto a priori senza finire nella censura né si può demandare tutto ai controllori umani, che in quanto tali non potrebbero reggere l’enorme mole di lavoro. La possibilità di aggiungere foto e video alla rilevazione automatica, tuttavia, rappresenta comunque una svolta di grande rilievo tanto per Facebook quanto per gli utenti.

L’argomento è stato toccato marginalmente anche dal post di ieri dello stesso fondatore Mark Zuckerberg. Nel suo testo dedicato alle prossime elezioni statunitensi, l’AD Facebook si è dilungato nello spiegare come l’obiettivo sia di evitare manipolazioni e ingerenze, e cosa è già stato fatto negli Stati Uniti e in altri paesi. Uno sforzo che include anche la lotta alle fake news, qualsiasi forma esse prendano. I risultati, si spera, non potranno che migliorare con i nuovi algoritmi di Intelligenza Artificiale.

Articolo Precedente

iPhone Xs e Xs Max, in Italia costano di più che negli altri paesi della zona euro

Articolo Successivo

Apple Watch Serie 4 può eseguire un “elettrocardiogramma”: utile ma incompleto per scopi medici