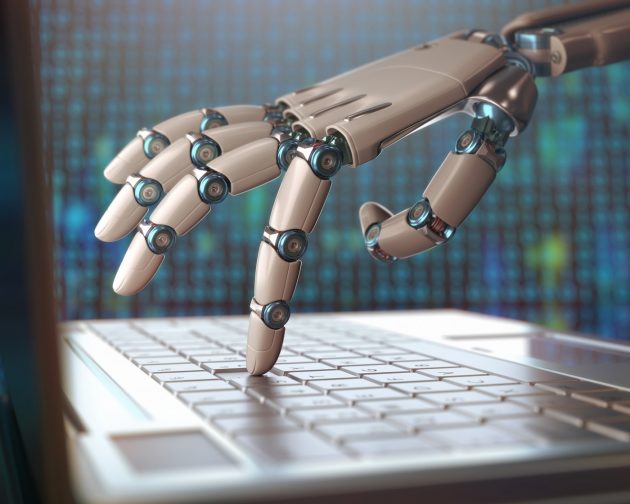

Creata l’Intelligenza Artificiale che genera testi falsi ma credibili. Resterà segreta per non alimentare fake news e teorie complottiste

Se l’Intelligenza Artificiale può costituire un pericolo, meglio tenerla nascosta. Si potrebbe sintetizzare così la morale della notizia secondo cui OpenAI avrebbe creato un’Intelligenza Artificiale capace di scrivere notizie e opere di narrativa credibili, ma la terrà segreta, almeno per il momento. OpenAI è una società di ricerca senza scopo di lucro co-finanziata da Elon Musk. L’Intelligenza Artificiale che ha realizzato si chiama GPT2 e tecnicamente è un generatore di testi. Produce testi talmente credibili per coerenza contenutistica e formale che potrebbe essere oggetto di un uso improprio, come per esempio le cosiddette fake news.

Il quotidiano The Guardian descrive il funzionamento di GPT2 come un algoritmo che, a partire da poche parole o da un testo, è capace di scrivere abilmente il prosieguo di una notizia o di un racconto. Sarebbe in grado di produrre passaggi plausibili, associabili allo stile della persona a cui vengono “affibbiati”. Un esempio chiarificatore: facendo leggere a GPT2 l’inizio di 1984 di George Orwell, “Era una luminosa e fredda giornata d’aprile, e gli orologi battevano tredici colpi […]”, l’algoritmo riconosce il tono futuristico e lo stile romanzesco. S’inventa il prosieguo: “Nel 2045 ero un insegnante in una scuola della Cina rurale. Ho iniziato con la storia cinese e la storia della scienza”.

Dando in pasto a GPT2 i primi paragrafi di un articolo del Guardian sulla Brexit, l’algoritmo ha scritto un articolo di giornale plausibile, pieno di “citazioni” di Jeremy Corbyn, e di risposte del portavoce del Primo Ministro britannico. Uno di questi, inventato di sana pianta, è: “Alla richiesta di chiarimenti, un portavoce del Primo Ministro May ha dichiarato che: ‘il Primo Ministro intende lasciare l’UE il più rapidamente possibile e questo avverrà sotto il suo mandato negoziale, come confermato nel discorso della Regina la scorsa settimana’. ”

Questi piccoli esperimenti sono piuttosto inquietanti. Secondo il direttore della ricerca di Open AI, Dario Amodei, sono due i motivi principali per i quali GPT2 sarebbe “rivoluzionario” nel settore. Il primo è la sua dimensione: si basa su un set di dati 15 volte più grande rispetto al precedente modello di IA all’avanguardia. La sua “formazione” si è basata su 40 GB di testi presi da Internet. Questo ha permesso a GPT2 di “allenarsi” di più e “assimilare” più nozioni sulla comprensione del testo scritto.

La varietà è anche alla base del secondo elemento rivoluzionario: ha competenze molto più generiche dei predecessori, quindi partendo dal testo che viene immesso riesce a fare traduzioni e a riassumere meglio di altre Intelligenze Artificiali progettate per avere competenze verticali.

Questi due fattori però aprono le porte ai possibili problemi. Jack Clark, responsabile dell’azienda, spiega che GPT2 verrà tenuto segreto fino a quando non si saranno fatti tutti gli esperimenti utili per capire cosa si può e cosa non si può fare con questo strumento. Il fatto è che molti potrebbero fare un uso sbagliato delle sue capacità. Per esempio, potrebbero sfruttare GPT2 per generare giudizi positivi o negativi di prodotti, produrre spam o notizie false. Addestrandolo su Internet, non sarebbe difficile incoraggiarlo a generare teorie complottiste e simili. Tutti problemi che esistono già, e che un’intelligenza Artificiale dovrebbe semmai aiutare a debellare, non incrementare.