Facebook sviluppa la tecnologia per rendere le persone in video irriconoscibili dai sistemi di riconoscimento facciale

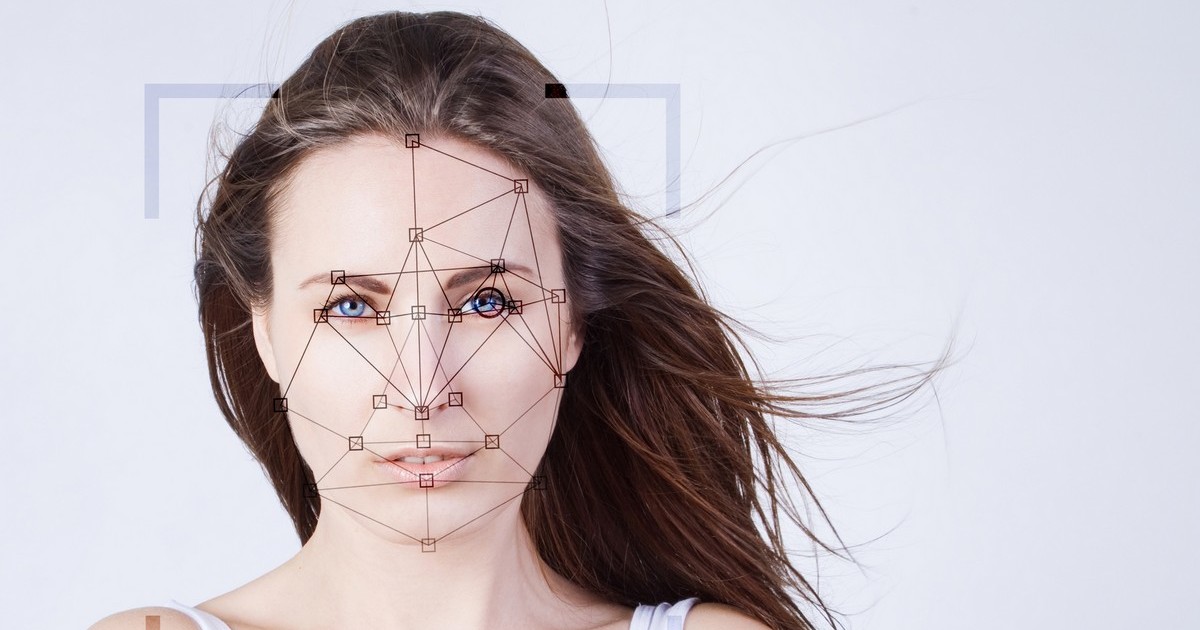

Il riconoscimento facciale può essere un'arma per la violazione della privacy e il controllo di massa. I ricercatori di Facebook AI Research inventano un modo per rendere irriconoscibili le persone in video agli occhi dei software di riconoscimento facciale.

Il riconoscimento facciale è di gran moda, con tutti i problemi che ne seguono. Quella che all’inizio sembrava una tecnologia utile si è presto trasformata in uno strumento di violazione della privacy e di controllo globale. Le molte critiche fin qui suscitate, hanno portato Facebook di recente a un cambiamento radicale: il riconoscimento facciale non è più attivato per default per i nuovi utenti. Non solo, i ricercatori di Facebook AI Research hanno affermato di avere creato un sistema di apprendimento automatico per la “de-identificazione” di individui raffigurati nei video.

Applicata ai video, questa è una novità. L’impossibilità di identificare gli utenti raffigurati in immagini fisse (ad esempio in foto) era già realtà grazie ad aziende come ad esempio D-ID, questa è la prima volta che la tecnologia funziona anche su video. Nei test iniziali, il metodo sviluppato da Facebook è stato in grado di contrastare sistemi di riconoscimento facciale all’avanguardia.

Dietro le quinte agisce un’Intelligenza Artificiale, che mappa una versione leggermente distorta del volto di una persona, così da renderne difficile l’identificazione mediante le tecnologie di riconoscimento facciale al momento in circolazione.

Nel documento ufficiale si legge che “il riconoscimento del volto può portare alla perdita di privacy. La tecnologia di sostituzione del volto può essere utilizzata in modo improprio. I recenti avvenimenti riguardanti progressi e abusi della tecnologia di riconoscimento facciale allertano sulla necessità di sviluppare metodi efficaci per la de-identificazione. Il nostro contributo è l’unico adatto al video, inclusi quelli dal vivo”.

Per ingannare i sistemi di riconoscimento facciale, Lior Wolf di Facebook e dell’Università di Tel Aviv, ha messo a punto una soluzione unica. Semplificando al massimo, l’Intelligenza Artificiale impiegata utilizza un’architettura encoder-decoder per generare sia una maschera che un’immagine. Durante la fase di apprendimento, il viso della persona viene distorto e quindi reimmesso nella rete. Il sistema genera in uscita immagini distorte e non distorte del volto di una persona e le incorpora nel video. Il risultato è che la persona che appare in video risulta perfettamente riconoscibile a un pubblico umano, ma non ai software di riconoscimento facciale.

Un portavoce dell’azienda ha però sottolineato ai giornalisti di VentureBeat che al momento Facebook non intende applicare questa tecnologia a nessuna delle sue app. Tuttavia, i volti anonimi nei video potrebbero essere utilizzati per addestrare alla privacy i sistemi di Intelligenza Artificiale. Il lavoro sarà presentato alla Conferenza internazionale sulla visione artificiale (ICCV 2019) che si tiene questa prossima a Seoul, in Corea del Sud.