L’anno scorso Facebook ha presentato Project Aria, un progetto di ricerca propedeutico alla realizzazione di visori per la realtà aumentata. Facebook all’epoca aveva parlato di un dispositivo in grado di ereditare molte delle funzioni per cui attualmente utilizziamo gli smartphone, come chiamare amici o cercare indicazioni stradali. Ora però il colosso di Menlo Park ha offerto un’anteprima del controller che dovrebbe essere abbinato a questi visori, rivelando una soluzione potenzialmente in grado di rivoluzionare il modo in cui interagiamo con la tecnologia: un “braccialetto” in grado di leggere gli ordini del nostro cervello e di tradurli in altrettanti “comandi digitali”.

L’idea, secondo i ricercatori dei Reality Labs di Facebook, è quella di utilizzare una tecnica nota come elettromiografia o EMG, in grado di rilevare segnali nervosi che viaggiano attraverso il polso, dove appunto un apposito dispositivo indossabile, dotato di sensori specializzati, sarebbe in grado di interpretare questi segnali e utilizzarli per controllare un dispositivo o un’interfaccia AR.

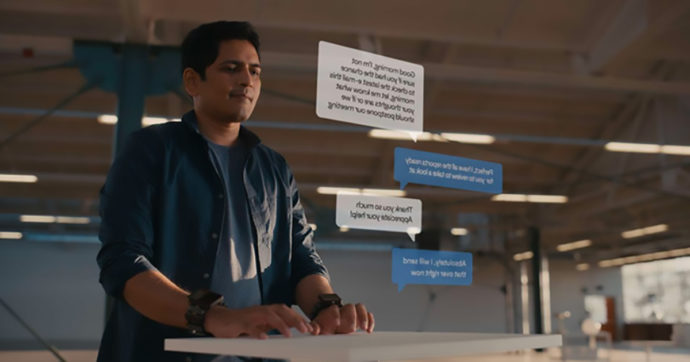

In pratica in futuro potremmo interagire con qualsiasi dispositivo tecnologico, come ad esempio un computer, senza avere con esso alcuna interazione fisica, ma semplicemente visualizzandone l’interfaccia tramite gli occhiali a realtà aumentata e impartendo i comandi tramite il braccialetto.

“Non è esattamente come leggere la mente”, ci ha tenuto però a chiarire Facebook in un post sul blog ufficiale. “Pensatela così: fate molte foto ma scegliete di condividerne solo alcune. Allo stesso modo ciascuno di noi ha molti pensieri ma sceglie di agire solo in base ad alcuni di essi. Quando ciò accade, il cervello invia segnali alle mani e alle dita dicendo loro di muoversi in modi specifici per eseguire azioni come digitare e scorrere. Si tratta di decodificare quei segnali al polso – le azioni che hai già deciso di eseguire – e tradurle in comandi digitali per il tuo dispositivo”.

Un vantaggio dell’utilizzo di un tale sistema, secondo Facebook, è che questa soluzione è così precisa da riuscire a rilevare un movimento di dita di appena un millimetro. Alla fine in effetti potrebbe addirittura non essere necessario muovere un dito a condizione che ci sia una “intenzione” di farlo. Questa precisione potrebbe anche potenzialmente rendere la navigazione delle interfacce AR un’esperienza molto più veloce rispetto al modo in cui attualmente interagiamo con la tecnologia. Ad esempio, i ricercatori di Facebook affermano che EMG potrebbe consentire alle persone di digitare su una tastiera virtuale a una velocità superiore a quella possibile su una tastiera meccanica.

Keller e altri ricercatori hanno sottolineato che questo lavoro è ancora in una fase molto precoce e che qualsiasi tipo di dispositivo a livello di consumatore è ancora lontano anni. E ci sono altri problemi che l’azienda dovrà affrontare al di fuori del funzionamento, soprattutto per quanto riguarda le immense preoccupazioni sulla privacy che accompagnano una piattaforma AR su Facebook. Project Air offre comunque uno sguardo indubbiamente intrigante sul possibile futuro del rapporto uomo-macchina.

Articolo Precedente

Sony SRS-XB12, altoparlante Bluetooth in offerta su Amazon con sconto del 42%

Articolo Successivo

Oppo Find X3 Pro 5G, recensione. Vicino alla perfezione, ma a che prezzo!